开启对话:隐私保护的新战场?

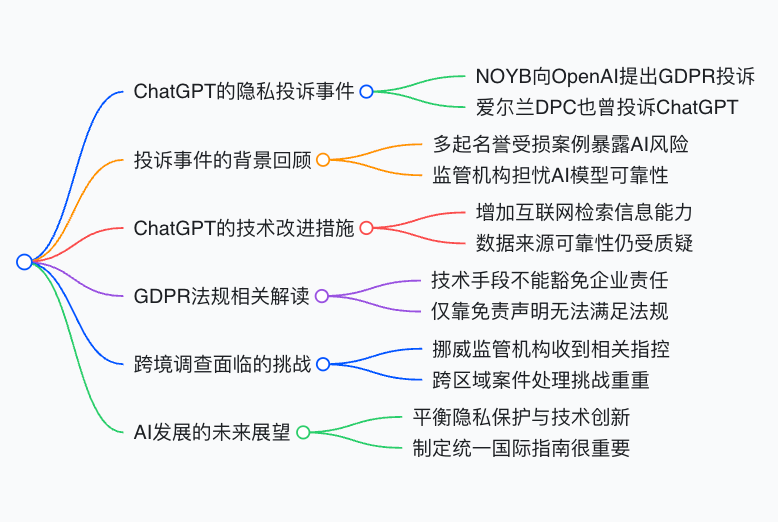

在数字时代,人工智能(AI)技术的应用日益广泛,其中自然语言处理领域的佼佼者 ChatGPT 已经成为全球用户交流和信息获取的重要工具。然而,在这一快速发展的同时,一个不容忽视的问题浮出水面——ChatGPT 产生的诽谤性言论可能违反了欧洲的《通用数据保护条例》(GDPR)。近期,非营利组织 NOYB 向 OpenAI 提出了 GDPR 投诉,质疑 ChatGPT 在生成内容时是否遵守了相关隐私法规。这不仅关乎技术本身的可靠性问题,更是对整个 AI 行业监管框架的一次严峻考验。

背景回顾:历史的警钟

早在今年早些时候,爱尔兰数据保护委员会(DPC)便曾就 ChatGPT 涉嫌传播不实信息的问题提出过投诉。此次 NOYB 的行动并非孤立事件,而是基于过去一系列关于个人名誉受损和信息失实的历史案例。这些案例揭示了 AI 模型在处理敏感个人信息时存在的潜在风险,引发了监管机构对模型可靠性的担忧。

技术更新:互联网搜索能力的加入

面对上述问题,OpenAI 采取了一系列措施以期改善 ChatGPT 的表现。其中最为显著的变化在于为该智能体增加了通过互联网检索信息的能力,旨在减少虚假信息的生成几率。然而,即便如此,关于数据来源可靠性的质疑并未完全消除,业界对于如何确保信息的真实性与完整性仍持谨慎态度。

法规解读:免责声明并非万能钥匙

NOYB 强调,在 GDPR 严格的监管框架下,即便是最先进的技术手段也不能成为豁免公司责任的借口。尽管 OpenAI 在减少虚假内容方面做出了努力,但仅靠添加免责声明是不够的——企业必须全面遵守相关法规要求。

持续挑战:挪威投诉与跨境调查

除了 DPC 的投诉尚未得到解决之外,NOYB 又将目光转向了挪威监管机构,指控 ChatGPT 内部留存的部分虚假数据未得到有效清理。这一系列行动表明,在处理涉及多个司法管辖区的跨区域案件时,现行法规体系仍面临许多挑战。

未来展望:亟需明确指导原则

随着 AI 技术在全球范围内的广泛应用,如何在保障个人隐私的同时促进技术创新成为了摆在各国监管者面前的一道难题。此次投诉案不仅反映了当前规范上的不足之处,更凸显了制定统一且具操作性的国际指南的重要性。

通过上述分析可以看出,尽管 OpenAI 努力改进其产品以适应愈加严格的法律法规环境,但要完全解决由此带来的挑战依然任重而道远。这不仅是对 OpenAI 的考验,更是整个 AI 行业向前迈进的一个重要节点。在追求技术创新的同时,如何平衡用户权益与企业利益之间的关系将成为未来发展的关键议题之一。

以上便是围绕 ChatGPT 遭遇 GDPR 投诉事件所展开的全面探讨。希望读者能够从中获得对当前技术发展趋势以及相关法规挑战更深层次的理解,并对未来可能的发展趋势有所展望。